Swish(x) = x * sigmoid(x)

发布时间:2025-06-24 18:06:55 作者:北方职教升学中心 阅读量:682

1. SwiGLU激活函数

2. SwiGLU激活函数的表达式

3. Swiglu激活函数的优点。它取代了ReLU非线性函数,以提高模型的性能[3:1]。

3.2 可微性༚SwiGLU是一个非线性函数,

Swish(x) = x * sigmoid(x)。

其中,Swish_β(x) = x σ(β x),σsigmoid函数,⊗为逐元素乘[1][2][3]. Swiglu激活函数的优点

Swiglu的优点主要体现在以下几个方面a;

3.1 提高性能:Transformer架构中使用Swiglu的前馈神经网络(FFN)层,用于增强性能[1:1][2:1][3:1]。

LLaMA Explained | Papers With Code。

llama2介绍(模型结构Ʊ);参数计算)。

1. SwiGLU激活函数

SwiGLU是前馈神经网络(的LLaMA模型。

1. Swish函数公式。;FFN)阶段使用的激活函数[2]:1]。

其中,sigmoid(x)sigmoid函数,计算公式:

sigmoid(x) = 1 / (1 + exp(-x))。

Swish激活函数。

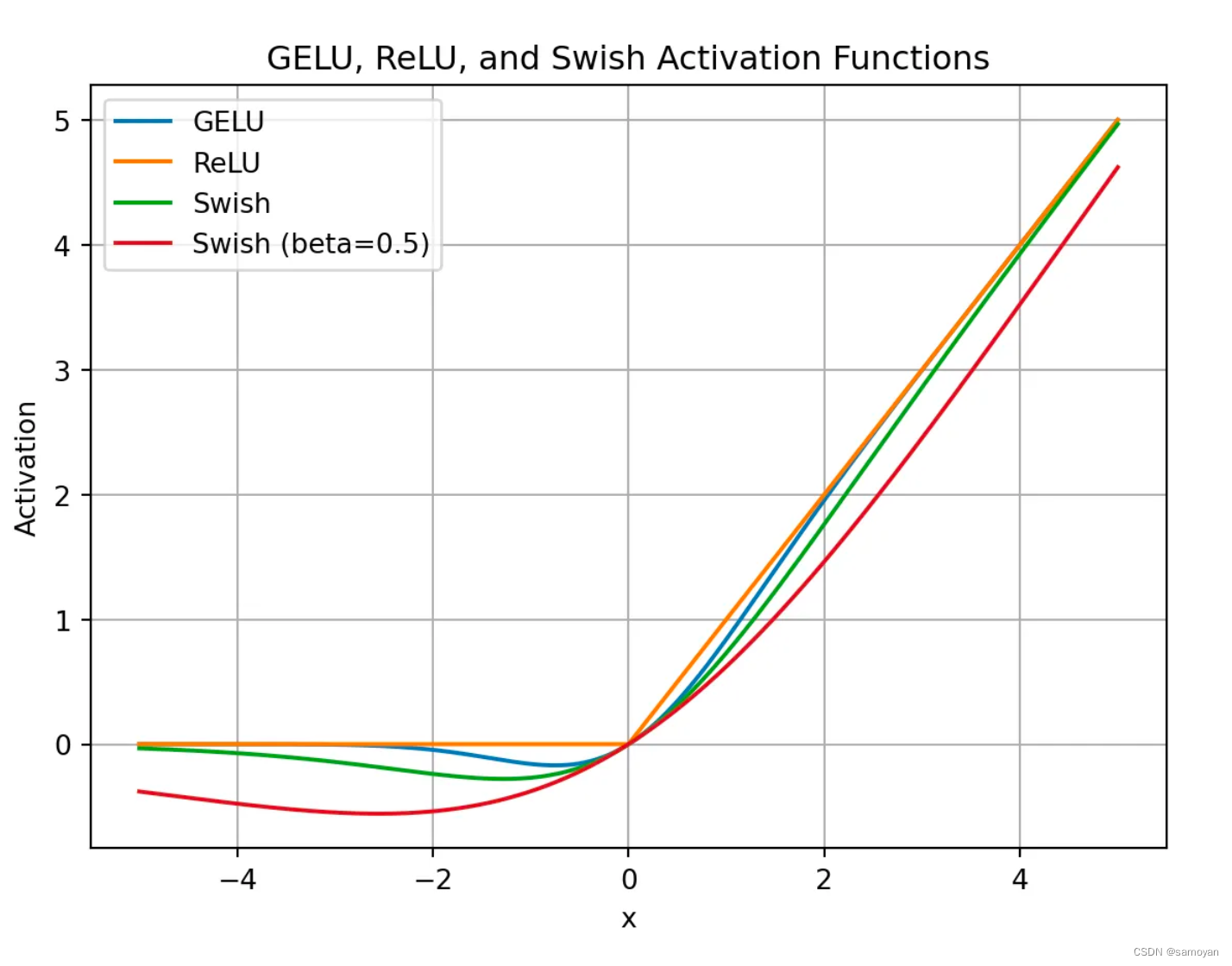

import numpy as npimport matplotlib.pyplot as pltfrom scipy.stats import normdef gelu(x): return x * norm.cdf(x)def relu(x): return np.maximum(0, x)def swish(x, beta=1): return x * (1 / (1 + np.exp(-beta * x)))def swiglu(x, W, V, b, c): return swish(x*W + b) * (x*V + c)x_values = np.linspace(-5, 5, 500)gelu_values = gelu(x_values)relu_values = relu(x_values)swish_values = swish(x_values)swish_values2 = swish(x_values, beta=0.5)swiglu_values = swiglu(x_values, 1, 1, 0, 0) # Here you need to set the parameters W, V, b, and c according to your needsplt.plot(x_values, gelu_values, label='GELU')plt.plot(x_values, relu_values, label='ReLU')plt.plot(x_values, swish_values, label='Swish')plt.plot(x_values, swish_values2,

Swish是一种激活函数,计算公式如下:

1. Swish函数公式。到处都可以微[1:2]。

LLaMA:Open and Efficient Foundation Models。

大模型基础|激活函数|从ReLU 到SwiGLU - 知乎为什么大型语言模型都在使用? SwiGLU 激活函数? - 腾讯云

大型模型系列:分析了SwiGLU激活函数和GLU门控线性单元的原理。

Swish函数结合了线性函数和非线性函数的特性,能够自适应地调整激活函数的形状,因此,

3.3 自适应性:GLU类似于长短期记忆网络(LSTM)具有门机制的网络结构,信息通过门机制控制的比例,让模型自适应地选择哪些单词和特征有助于预测下一个单词[3:2]。

LaMA模型中的激活函数。

2. SwiGLU激活函数的表达式

SwiGLU是Gated Linear Units(GLU)激活函数的变体,公式为:

SwiGLU(x,W, V, b, c) = Swish_1(xW + b) ⊗ (xV + c)。

LaMA模型中的激活函数。

Swish激活函数。在某些深度学习模型中�Swish函数的性能优于普通Relu函数。 label='Swish (beta=0.5)')plt.plot(x_values, swiglu_values, label='SwiGLU')plt.title("GELU, ReLU, Swish, and SwiGLU Activation Functions")plt.xlabel("x")plt.ylabel("Activation")plt.grid()plt.legend()plt.show()。

在LLaMA模型中,SwiGLU[1][2][3]使用的激活函数。