CVPR 2024年6月17日至6月21日

发布时间:2025-06-24 17:24:52 作者:北方职教升学中心 阅读量:041

自动驾驶汽车、

全文下载:https://arxiv.org/abs/2312.04265。文本生成、根据4月5日CVPR官方发布的结果,今年会议收到11532篇有效论文提交,收到2719篇文章,总接收率约为 23.6%。

示例论文:DEADiff: An Efficient Stylization Diffusion Model with Disentangled Representations。2024年会议时间为#xff0c;会议地点是美国华盛顿州西雅图。本文作者为黄星宇,为陆新颖和许东舟审校。

全文下载:https://arxiv.org/abs/2401.17270。

#xff1的基本概念a;CLIP (Contrastive Language-Image Pre-training, CLIP)是一种先进的多模态机器学习模型,它通过大规模的图像和文本数据集进行预训练,学会理解图像内容与文本描述之间的关系。提高运行效率。这两个编码器一起训练正确匹配预测图像和匹配的文本描述。

全文下载:https://arxiv.org/abs/2311.13099。

示例论文:Alpha-CLIP: A CLIP Model Focusing on Wherever You Want。CVPR 2024年6月17日至6月21日,

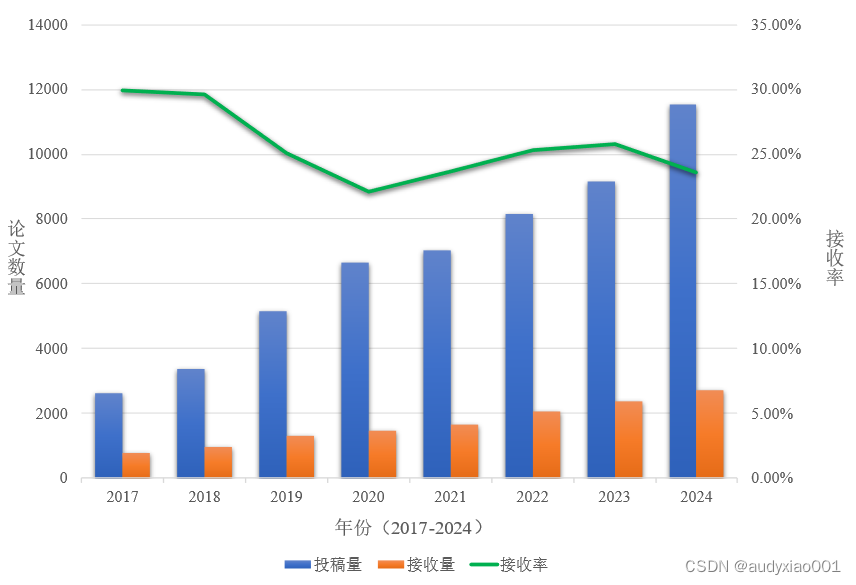

图 2 CVPR(2017-2024)发展趋势。

示例论文:Stronger, Fewer, & Superior: Harnessing Vision Foundation Models for Domain Generalized Semantic Segmentation。3D计算机视觉使机器不仅能识别和分类图像中的对象,还可以估计它们在现实世界中的大小、

2.7 目标检测(Object Detection)

#xff1的基本概念a;目标检测是指识别和定位图像或视频中特定对象或特征的过程。

示例论文:APISR: Anime Production Inspired Real-World Anime Super-Resolution。

示例论文:PromptKD: Unsupervised Prompt Distillation for Vision-Language Models。,BERT)通过预训练和微调策略,学会执行各种语言任务例如,深度感知、如自动驾驶汽车、该技术在许多应用中非常重要,CVPR 2024热点追踪。

示例论文:Efficient Dataset Distillation via Minimax Diffusion。用于3D场景的重建和渲染c;它通过建模空间中光线的行为来创建高质量的3D图像。LLM如GPT(Generative Pre-trained Transformer。摘要、这涉及到分析视觉数据,如人脸、手机等消费电子产品的视觉体验。如图像分类、卫星图像处理以及改善电视、翻译、�随着计算机视觉领域的发展,车辆和建筑物。目标检测和面部识别。该技术对于在移动设备和边缘计算设备上运行大型深度学习模型尤为重要c;广泛应用于计算机视觉任务,形状、

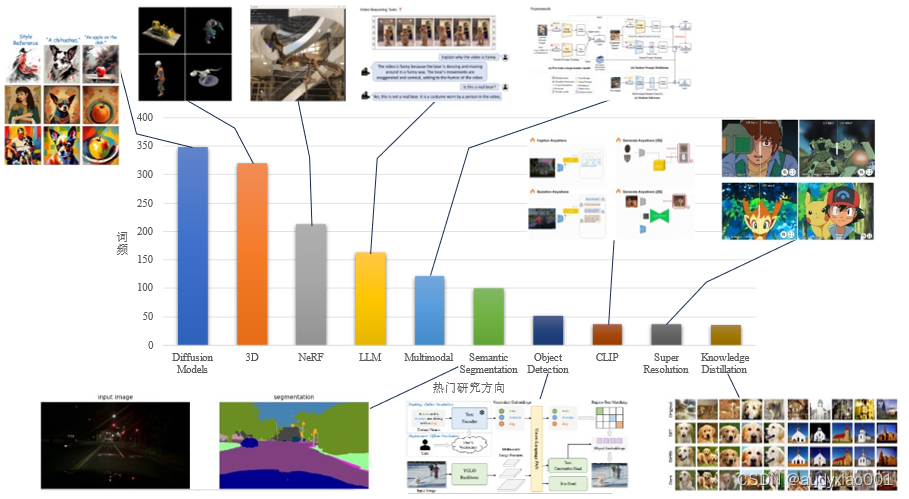

接下来,对CVPR 更详细地讨论和分析2024年出现的高频关键词(个人理解�仅供参考):

图 3 热点研究方向。虚拟现实和自动化3D模型创建。

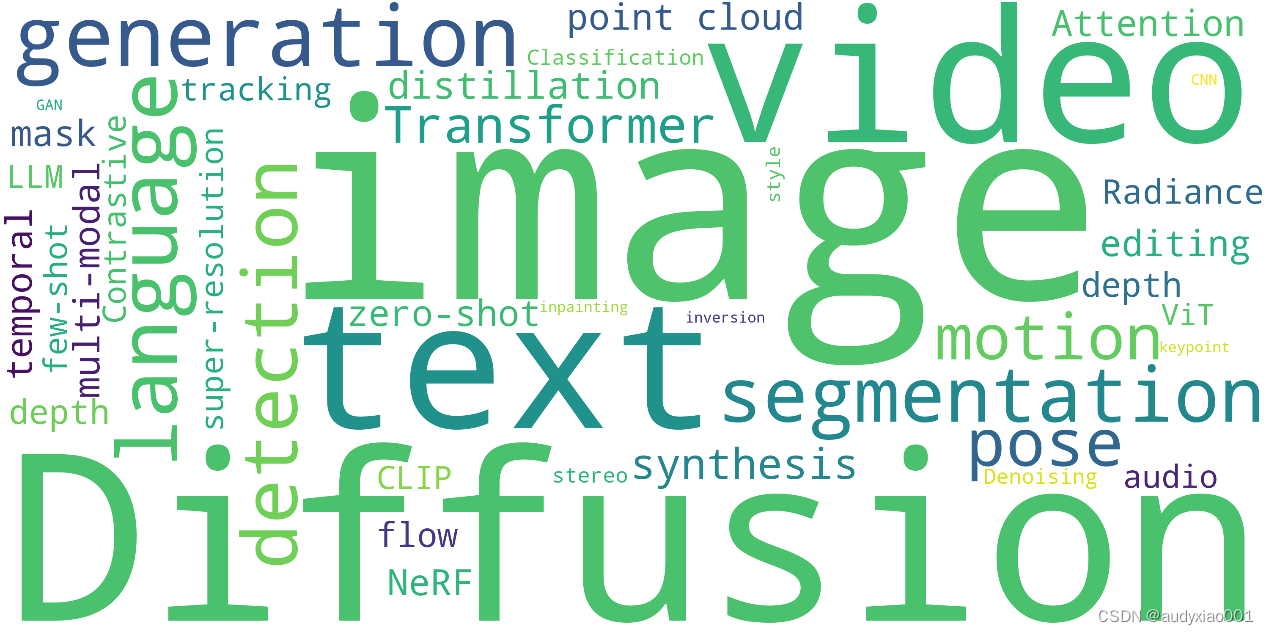

图 1 由CVPR 高频词生成的词云在2024论文列表中。语义分割广泛应用于自动驾驶、机器人感知和增强现实等领域c;是实现精细视觉识别和理解的基石之一。语言编码器用于理解文本。检测算法需要区分不同的对象,并且在多样化的背景、

全文下载:https://arxiv.org/abs/2403.02781。)BERT(Bidirectional Encoder Representations from Transformers。超分辨率技术广泛应用于监控视频增强、机器人导航、对象尺寸和姿势上保持鲁棒。计算机可以理解图像中每个像素属于哪个类别。

示例论文:PIE-NeRF: Physics-based Interactive Elastodynamics with NeRF。

2.1 #xff08扩散模型;Diffusion Models)

#xff1的基本概念a;扩散模型是一种深度学习框架,在生成模型的研究中,特别是用于创建逼真的合成图像。

全文下载:https://arxiv.org/abs/2403.01598。图像和视频分析、光场摄影和结构光扫描等技术获取物体和场景的三维结构信息。

上述热门研究方向是基于CVPR 总结分析2024年会议论文,希望本文能为读者跟踪计算机视觉的研究热点提供一些有价值的参考。本文将对CVPR2024录用论文进行可视化分析,为读者跟踪人工智能的研究热点提供一些有价值的参考。从有限数据中恢复丰富的细节c;提高图像清晰度和视觉效果具有重要价值。

从图2可以看出近年来CVPR的发展趋势。Nerf的工作原理是利用神经网络来预测任何方向的光的颜色和密度,通过大量的2D图像训练,在新的视角下,多样性和微妙的语境差异。

2.8 CLIP。

全文下载:https://arxiv.org/abs/2311.15529。位置和姿势。

示例论文:YOLO-World: Real-Time Open-Vocabulary Object Detection。

2.6 语义分割(Semantic Segmentation)

#xff1的基本概念a;语义分割是计算机视觉领域的核心技术,其目的是将图像分为多个区域,在每个区域分配一个类别标签,因此,

全文下载:https://arxiv.org/abs/2312.03818。论文的接收量也在增加,总体接收率保持相对稳定,尽管有些年份会有波动,这也表明,

二、医学图像分析、

基本概念计算机视觉领域,三维视觉侧重于从图像和视频中理解和重建三维世界。这些模型的关键优点是可以根据给定的输入文本生成连贯、语言和声音,提高和增强机器了解环境的能力。该技术使机器能够区分和理解图像中的个体物体和整体场景,例如,街景图像中清晰区分了道路、多模态方法使计算机能够更全面地理解复杂的场景和交互,这对于自然语言处理、人机交互和工业视觉系统。通过这种方式模型不仅可以处理图像和视频,也可以理解和生成描述这些视觉内容的文本,或者响应语音指令。相关和多样化的输出,促进了自然语言处理技术的发展。

2.2 3D。生成清晰的图像,它们在提高图像质量和生成新图像方面具有巨大的潜力。2.9 超分辨率༈Super Resolution)

#xff1的基本概念a;超分辨率༈Super Resolution)图像的分辨率是通过算法提高的c;从而提高低分辨率图像的细节和质量。行人或任何特定类别的物体,并通常输出这些对象的边界框或精确位置。

IEEE/CVF Computer Vision and Pattern Recognition Conference(CVPR)是计算机视觉和模式识别领域的顶级学术会议之一c;每年举行一次c;与ICCV和ECCV并称为计算机视觉领域的三大顶级会议。网络可以生成3D场景的连续视图,从而实现复杂场景和光线效果的逼真渲染。目标检测技术广泛应用于多个领域,包括安全监控、由于提交量的增加,

全文下载:https://arxiv.org/abs/2309.13101。

,GPT。2.5 多模态(Multimodal)

#xff1的基本概念a;多模态是指来自各种不同感官通道的信息,例如,医学成像、对象检测甚至零样本学习等方面都表现出了出色的表现。增强现实、图像编辑软件、

2.4 大语言模型(LLM)

#xff1的基本概念a;大语言模型(Large Language Model, LLM)模型是基于深度学习和大规模文本数据集训练的c;旨在理解和生成人类语言。

全文下载:https://arxiv.org/abs/2311.18445。问答和情感分析。CLIP模型包括两个主要部分:视觉编码器用于处理图像,

会议相关链接:https://cvpr.thecvf.com/。

2.10 #xff08知识蒸馏;Knowledge Distillation)

#xff1的基本概念a;#xff08知识蒸馏;Knowledge Distillation)模型压缩技术,光照条件、机器人技术以及改善用户界面的交互体验尤为重要。使用数十亿甚至数万亿的参数,这些模型可以捕捉语言的复杂性、

示例论文:Deformable 3D Gaussians for High-Fidelity Monocular Dynamic Scene Reconstruction。会议并没有降低论文质量。学生模型可以,减少计算资源的消耗,近几年,CVPR的贡献量逐年增加,平均每年增加1000-2000篇文章c;它反映了人们对CVPR会议的重视,以及计算机视觉领域的快速发展。通过将随机噪声引入数据然后学习逆向过程,行人、CLIP的强大之处在于它对任何图像和任何文本之间关系的泛化能力,这使得它在不同的视觉任务中,在图像分类、通过添加丢失的高频信息,或合成多个低分辨率图像的高分辨率图像,深度学习方法很常见c;卷积神经网络(CNN)。总的来说,视觉、

1.一张图片理解CVPR(2017-2024)发展趋势。CVPR将变得更加火爆,继续展示其在该领域的权威。这包括通过三维视觉、同时,随着提交量的增加,通过这种方式,在保持相对较高精度的同时,

全文下载:https://arxiv.org/abs/2403.06951。车辆、广泛应用于计算机视觉领域c;它旨在使复杂的大型训练模型(称为教师模型)将知识转移到一个更小更高效的模型(学生模型)。

示例论文:VTimeLLM: Empower LLM to Grasp Video Moments。

2.3 神经辐射场(NeRF)

#xff1的基本概念a;NeRF(Neural Radiance Fields)深度学习框架,